CHIŃSKI POKÓJ: eksperyment, który zmienił spojrzenie na sztuczną inteligencję

Czy maszyna może myśleć? A może jest ograniczona do procesów, które tylko wydają się inteligentne?

Chiński pokój to eksperyment myślowy, który zajmuje zaszczytne miejsce w dyskusji nad możliwościami i ograniczeniami sztucznej inteligencji.

Przyjrzyjmy się bliżej temu, na czym polega chiński pokój, jak zmienił postrzeganie AI oraz dlaczego pozostaje jednym z najważniejszych argumentów w debacie o przyszłości myślenia maszynowego.

Spis treści

Na czym polega CHIŃSKI POKÓJ?

Wyobraź sobie, że siedzisz w zamkniętym pokoju, a przez szczelinę trafiają do ciebie karteczki z pytaniami zapisanymi po chińsku. Problem w tym, że nie znasz ani jednego chińskiego słowa. Masz jednak do dyspozycji wielką księgę z bardzo szczegółowymi instrukcjami – patrzysz na otrzymany chiński znak, wyszukujesz go w księdze, a następnie przepisujesz odpowiedź, której księga każe ci użyć.

Choć nie rozumiesz ani pytania, ani odpowiedzi, twoje działania są tak dokładne, że osoba po drugiej stronie – ta, która podaje pytania – ma wrażenie, że komunikuje się z kimś, kto płynnie posługuje się chińskim. Ale czy w tej sytuacji ty naprawdę rozumiesz język, którym się posługujesz?

EKSPERYMENT MYŚLOWY

Narzędzie wykorzystywane w filozofii i nauce. Wyobrażony scenariusz, który pomaga lepiej zrozumieć trudne idee i ich konsekwencje, bez przeprowadzania realnych doświadczeń

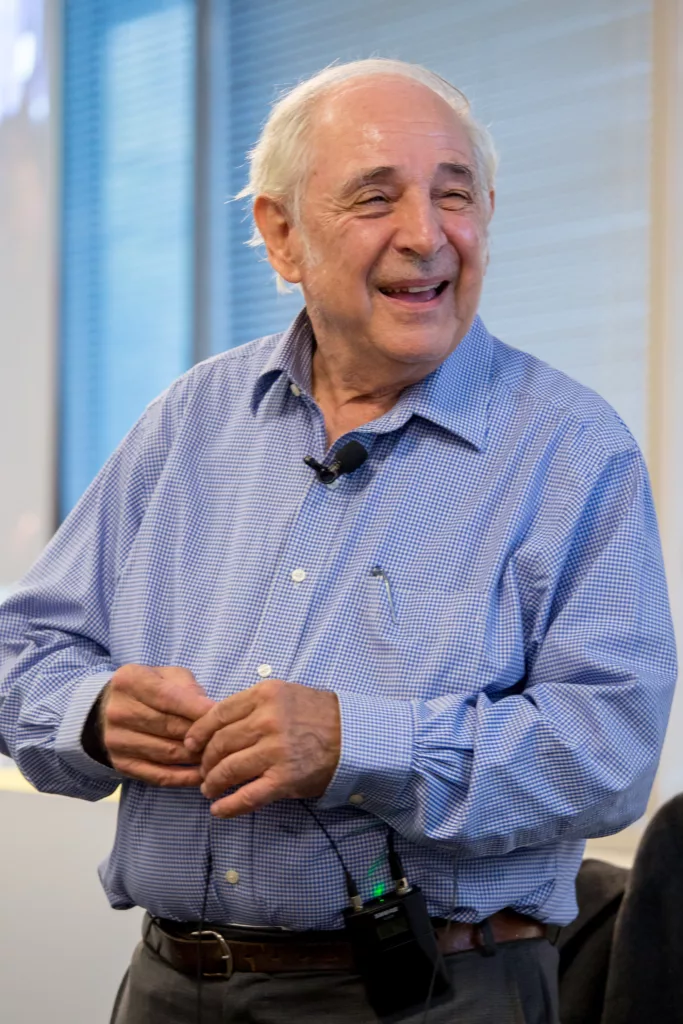

John Searle, twórca tego eksperymentu myślowego, pokazuje nam, że nawet jeśli komputer (czyli w tym przypadku metaforyczna osoba w pokoju) może dostarczyć poprawnych odpowiedzi, nie oznacza to, że “rozumie” dane wejściowe. Komputer działa zgodnie z określonymi regułami, ale nie ma świadomości znaczenia przetwarzanych symboli.

Chiński pokój krok po kroku ilustruje różnicę między przetwarzaniem informacji a prawdziwym rozumieniem.

Sztuczna inteligencja, nawet jeśli wydaje się inteligentna, może jedynie symulować rozumienie – przetwarzać informacje, ale bez rozumienia ich znaczenia.

Dlaczego chiński pokój jest ważny w kontekście AI?

John Searle, autor eksperymentu myślowego „chiński pokój”, chciał pokazać, że istnieje zasadnicza różnica między symulacją rozumienia a prawdziwym rozumieniem. Twierdził, że maszyny, niezależnie od tego, jak dobrze imitują ludzkie zachowania, w rzeczywistości nie myślą ani nie rozumieją, lecz jedynie przetwarzają symbole zgodnie z algorytmami.

Searle zestawia swoją teorię z koncepcją sztucznej inteligencji – w szczególności tzw. sztucznej inteligencji silnej, która zakłada, że odpowiednio zaawansowany komputer może kiedyś dorównać ludzkiej świadomości. Argumentuje, że komputery nie mają “umysłów”, bo nie są w stanie nadać znaczenia przetwarzanym symbolom, a więc nie mogą naprawdę myśleć ani rozumieć świata.

To fundamentalne wyzwanie dla optymistów, którzy wierzą w przyszłość AI jako narzędzia zdolnego do osiągnięcia ludzkiego poziomu intelektu i świadomości.

Jak robot odpowiada na argument o chińskim pokoju?

Obrońcy sztucznej inteligencji mają swoje odpowiedzi na argument Searle’a.

Przede wszystkim zwracają uwagę na to, że chiński pokój może opierać się na błędnym założeniu – że rozumienie maszynowe musi być identyczne z ludzkim rozumieniem. Roboty i komputery, według tej perspektywy, mogą rozumieć świat na swój własny sposób, który różni się od naszego, ale wciąż może być uznany za „prawdziwe” rozumienie.

W praktyce, współczesne systemy AI, takie jak GPT, radzą sobie z coraz bardziej złożonymi zadaniami. Choć nie mają świadomości w tradycyjnym sensie, niektórzy eksperci sugerują, że ich zdolności już teraz mogą być uważane za formę ograniczonego rozumienia.

Jednym z głównych kontrargumentów jest także to, że w miarę rozwoju technologii AI, maszyny mogą coraz bardziej przypominać ludzki sposób przetwarzania informacji. W ten sposób, nawet jeśli obecnie AI działa na zasadzie „chińskiego pokoju”, przyszłe systemy mogą przekroczyć te ograniczenia.

Twierdzę, że zaprogramowany komputer rozumie dokładnie tyle, co samochód i maszyna do liczenia – czyli dokładnie nic.

John Searle (tłum. własne)

Chiński pokój a świadomość: Czy maszyny mogą naprawdę myśleć?

Pytanie o to, czy maszyny mogą naprawdę myśleć, dotyczy nie tylko możliwości technicznych, ale także naszej definicji świadomości i rozumienia. Searle twierdzi, że przetwarzanie informacji przez komputery nie jest tożsame z myśleniem, ponieważ brakuje w nim świadomości, czyli wewnętrznego poczucia istnienia, jakie mają ludzie.

Z drugiej strony, niektórzy badacze sugerują, że świadomość może być jedynie wynikiem wystarczająco złożonego systemu przetwarzania informacji. Według tej teorii, gdy AI osiągnie odpowiedni poziom złożoności, może pojawić się forma świadomości, choćby była bardzo różna od ludzkiej świadomości.

Chiński pokój pokazuje nam zatem kilka z najważniejszych zagadek współczesnej filozofii: co tak naprawdę oznacza myślenie? Czym jest świadomość? Jak zidentyfikować i zmierzyć te zjawiska?

Ograniczenia eksperymentu chińskiego pokoju

Mimo swojej popularności, eksperyment myślowy Searle’a nie jest wolny od krytyki. Przeciwnicy wskazują, że eksperyment skupia się wyłącznie na poziomie symbolicznym i nie uwzględnia innych aspektów, takich jak nauka czy kontekst. Komputery uczące się, które wykorzystują techniki takie jak deep learning, mogą nie przetwarzać symboli w sposób bezmyślny, jak w chińskim pokoju, lecz na bazie ogromnych zbiorów danych nabywać pewną formę intuicji.

Krytycy również zauważają, że Searle nie daje jasnej odpowiedzi na to, czym właściwie jest „prawdziwe” rozumienie. Czy jeśli AI nauczy się przewidywać odpowiedzi lepiej niż człowiek, nie powinniśmy uznać, że posiada pewien poziom rozumienia?

Okazało się, że eksperyment myślowy Searle’a stał się bodźcem do długiej i burzliwej dyskusji. Jej początkiem było 27 komentarzy, w większości negatywnych.W dwa lata później 7 kolejnych prac na temat Chińskiego Pokoju zostało opublikowanych na łamach tego samego czasopisma. Obie serie stanowią najobszerniejszą dyskusję nad argumentem. Naturalnie nie były to jedyne artykuły — po 1982 roku spory nie wygasły i trwają do dziś; raz podjęty temat na stałe zagościł w dyskusjach filozofów nauki, psychologów, naukowców z kręgu sztucznej inteligencji, lingwistów, neurologów itp.

Józef Kloch

Oto kilka przykładów z często podnoszonych kontrargumentów wobec Chińskiego Pokoju:

- Człowiek w Chińskim Pokoju to tylko część większego systemu, który obejmuje symbole, zasady, pytania i odpowiedzi. Choć sam człowiek nie rozumie, zdolność rozumienia ma cały system. Kluczowe jest spojrzenie na wszystkie elementy razem.

- Człowiek w Chińskim Pokoju jest odizolowany, więc aby mógł rozumieć i mieć stany umysłowe, trzeba dać mu kontakt ze światem zewnętrznym.

- Umysł ludzki to nie tylko przetwarzanie symboli, ale także bardziej złożone interakcje między różnymi poziomami przetwarzania danych, z których człowiek nie zawsze jest świadomy. Komputery mogą więc osiągnąć zrozumienie, jeśli ich działanie uwzględni te złożoności.

Jak eksperyment chiński pokój wpłynął na rozwój sztucznej inteligencji?

Choć eksperyment myślowy Searle’a miał na celu podważenie wiary w sztuczną inteligencję, paradoksalnie przyczynił się do jej rozwoju. Stymulował debatę nad granicami AI i zmusił badaczy do postawienia fundamentalnych pytań: Czy sztuczna inteligencja może naprawdę myśleć? Jak definiować rozumienie? Co odróżnia maszynę od człowieka?

Te pytania stały się podstawą wielu badań w dziedzinie kognitywistyki, neurobiologii oraz informatyki, prowadząc do rozwoju takich technologii jak uczenie maszynowe, sieci neuronowe i modele generatywne. Chiński pokój zmusił naukowców do szukania nowych sposobów na zrozumienie i rozwinięcie potencjału maszyn w kierunku rzeczywistej inteligencji.

Podsumowanie: Czy chiński pokój nadal ma znaczenie w 2025 roku?

W 2025 roku, kiedy sztuczna inteligencja nieustannie się rozwija, eksperyment chiński pokój pozostaje ważnym punktem odniesienia w dyskusji na temat AI. Wciąż przypomina nam, że przetwarzanie informacji to nie to samo, co rozumienie, i zmusza do refleksji nad tym, co naprawdę oznacza „inteligencja”.

Choć współczesne systemy AI zaskakują swoimi możliwościami, chiński pokój uświadamia nam, że technologia może jedynie symulować ludzkie myślenie, a nie je odzwierciedlać. To sprawia, że pytanie o to, czy maszyny mogą naprawdę myśleć, jest bardziej aktualne niż kiedykolwiek.

W miarę jak AI staje się coraz bardziej zaawansowana, chiński pokój przypomina, że granica między symulacją a rzeczywistością może być trudna do zdefiniowania.